Introducción y desmitificación de la IA

1. Introducción

En la era digital que vivimos, la Inteligencia Artificial (IA) ha dejado de ser un concepto de ciencia ficción para convertirse en una realidad que permea casi todos los aspectos de nuestra vida cotidiana. Desde los asistentes virtuales en nuestros teléfonos hasta los algoritmos que personalizan nuestra experiencia en redes sociales, la IA está omnipresente. Sin embargo, con esta presencia vienen también importantes cuestionamientos éticos que no podemos ignorar.

1.1 Objetivo del taller

Este taller tiene como objetivo principal dotar a nuestros estudiantes de las herramientas necesarias para entender, analizar y enfrentar los desafíos éticos que plantea la IA en nuestra sociedad. No se trata solo de comprender cómo funciona la tecnología, sino de desarrollar un pensamiento crítico que les permita navegar en este nuevo paisaje tecnológico con responsabilidad y conciencia ética.

1.2 Importancia de la ética en la era de la IA

La ética en la era de la IA no es un lujo filosófico, sino una necesidad práctica. A medida que delegamos más decisiones y tareas a sistemas de IA, se vuelve crucial entender las implicaciones éticas de estas delegaciones. ¿Quién es responsable cuando una IA comete un error? ¿Cómo aseguramos que estos sistemas no perpetúen o amplifiquen los sesgos existentes en nuestra sociedad?

Estas preguntas no son meramente teóricas. Las respuestas que demos como sociedad moldearán el futuro de nuestra interacción con la tecnología y, por extensión, entre nosotros mismos. Por eso, es fundamental que nuestros jóvenes, como futuros ciudadanos y posibles desarrolladores de estas tecnologías, estén bien equipados para abordar estos dilemas.

2. Actividad de apertura: «El juego de los mitos de la IA»

Para comenzar nuestro viaje de exploración ética, vamos a sumergirnos en el mundo de los mitos y realidades de la IA. Este juego nos ayudará a identificar y desafiar algunas de las concepciones erróneas más comunes sobre la IA.

2.1 Instrucciones del juego

- Dividiremos la clase en grupos de 4-5 estudiantes.

- Cada grupo recibirá un conjunto de tarjetas. Cada tarjeta contendrá una afirmación sobre la IA.

- Los grupos tendrán 15 minutos para clasificar estas afirmaciones en tres categorías: «Mito», «Realidad» o «No estamos seguros».

- Después de la clasificación, cada grupo presentará brevemente sus decisiones y el razonamiento detrás de ellas.

2.2 Lista de mitos comunes sobre IA

Algunas de las afirmaciones en las tarjetas incluirán:

- La IA pronto superará la inteligencia humana en todos los aspectos.

- Las IA no tienen sesgos como los humanos.

- La IA eliminará todos los trabajos en el futuro.

- Las IA pueden entender y tener emociones como los humanos.

- La IA es completamente autónoma y toma sus propias decisiones.

- La IA puede resolver cualquier problema si se le proporciona suficientes datos.

- Las IA son objetivas y siempre toman decisiones más justas que los humanos.

- Una vez que una IA está programada, no necesita supervisión humana.

- La IA puede predecir el futuro con precisión.

- Las IA son capaces de ser creativas y generar ideas originales por sí mismas.

2.3 Dinámica de grupo para clasificar mitos

Observaremos cómo los grupos debaten y llegan a consensos. Este proceso no solo nos dará una idea de las percepciones actuales de los estudiantes sobre la IA, sino que también fomentará el pensamiento crítico y el debate constructivo.

3. Desmitificando la IA

Tras el juego, es hora de separar el grano de la paja y abordar estos mitos con información precisa y actualizada.

3.1 Análisis de los mitos más votados

Para cada mito, utilizaremos los siguientes prompts para buscar información y analizar:

- «¿Cuál es el estado actual de la investigación sobre [insertar tema del mito]?»

- «¿Qué dicen los expertos en IA sobre [insertar afirmación del mito]?»

- «¿Existen estudios o experimentos que confirmen o refuten [insertar mito]?»

- «¿Cuáles son las limitaciones actuales de la IA en relación con [insertar tema del mito]?»

- «¿Cómo ha evolucionado la percepción de [insertar tema del mito] en la comunidad científica en los últimos años?»

3.2 Datos y hechos que contrarrestan estos mitos

Utilizaremos los prompts anteriores para buscar información en fuentes confiables. Por ejemplo, para el mito «La IA eliminará todos los trabajos en el futuro», podríamos encontrar:

- Estudios del Foro Económico Mundial sobre el futuro del trabajo y la IA.

- Informes de la OIT (Organización Internacional del Trabajo) sobre el impacto de la automatización en el empleo.

- Investigaciones académicas sobre la creación de nuevos tipos de trabajos debido a la IA.

3.3 Discusión guiada sobre las fuentes de estos mitos

Exploraremos de dónde vienen estas ideas. ¿Son producto de la ciencia ficción? ¿De malentendidos sobre cómo funciona la tecnología? ¿O quizás de temores más profundos sobre el cambio tecnológico? Esta discusión nos ayudará a entender cómo se forman y propagan los mitos tecnológicos.

3.4 Herramientas para encontrar información contrastada

Para asegurar que estamos utilizando información precisa y actualizada, utilizaremos las siguientes herramientas y recursos:

- Google Scholar: Una herramienta de búsqueda específica para literatura académica. Útil para encontrar artículos científicos revisados por pares sobre IA y sus implicaciones.

- arXiv.org: Un repositorio de preprints en campos como la informática y la inteligencia artificial. Ofrece acceso a investigaciones recientes, aunque algunas pueden no estar aún revisadas por pares.

- IEEE Xplore: Una biblioteca digital que proporciona acceso a publicaciones técnicas en ingeniería y tecnología, incluyendo muchos artículos sobre IA.

- ACM Digital Library: Otra fuente importante de publicaciones académicas en el campo de la informática e IA.

- AI100 de Stanford: Un proyecto de la Universidad de Stanford que estudia y anticipa los efectos de la IA en la sociedad.

- Informes de organizaciones internacionales: Como los de la OCDE, la UNESCO o el Banco Mundial, que a menudo incluyen análisis detallados sobre el impacto de la IA.

Utilizando estas herramientas, podremos encontrar información contrastada y actualizada para analizar la veracidad de los mitos sobre IA, proporcionando a los estudiantes una base sólida para su comprensión del tema.

4. Conexión histórica: Tecnología y sociedad

Para poner nuestras discusiones en perspectiva, haremos un breve viaje por la historia de la tecnología y su impacto en la sociedad.

4.1 Breve recorrido por pánicos tecnológicos del pasado

Examinaremos cómo otras tecnologías en el pasado generaron temores similares a los que vemos hoy con la IA. Por ejemplo:

- En el siglo XIX, hubo quienes temían que viajar en tren a altas velocidades podría ser físicamente peligroso para el cuerpo humano.

- La introducción del teléfono generó preocupaciones sobre la pérdida de la privacidad y la erosión de las relaciones personales.

4.2 Paralelos con los mitos actuales sobre IA

Trazaremos paralelos entre estos pánicos históricos y los mitos actuales sobre la IA. Esto nos ayudará a entender que, aunque la tecnología de la IA es nueva, muchos de nuestros temores y esperanzas sobre ella son sorprendentemente similares a los que hemos tenido con otras tecnologías en el pasado.

Esta perspectiva histórica no pretende desestimar las preocupaciones éticas legítimas sobre la IA, sino proporcionarnos un contexto más amplio para abordarlas. Nos recuerda que, como sociedad, tenemos una larga historia de adaptación y regulación de nuevas tecnologías.

Al final de esta primera parte del taller, habremos sentado las bases para una comprensión más matizada y crítica de la IA, liberándonos de los mitos más comunes y preparándonos para un análisis ético más profundo en las secciones siguientes.

Fundamentos de la IA y ética

5. Introducción a la IA

5.1 Definición y conceptos básicos

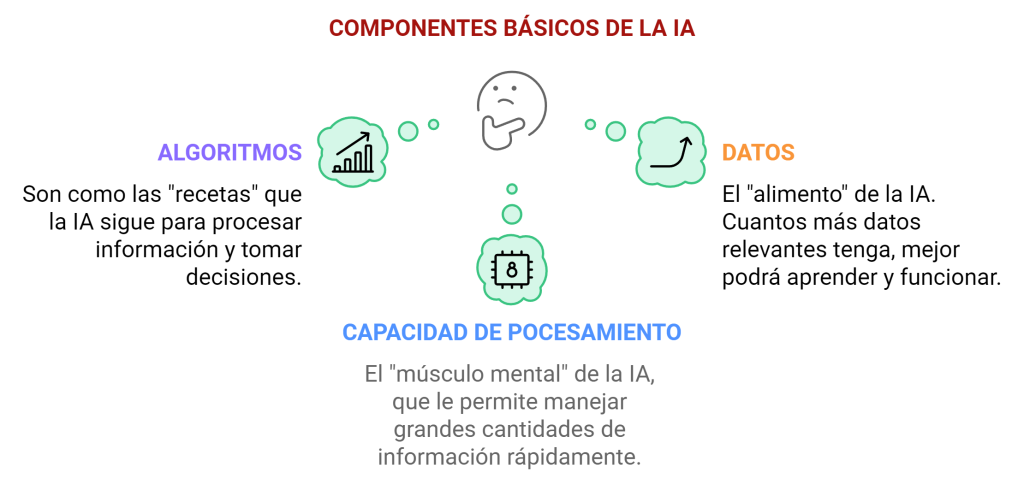

La Inteligencia Artificial (IA) es un campo de la informática que busca crear sistemas capaces de realizar tareas que normalmente requieren inteligencia humana. Pero, ¿qué significa esto realmente?

Imaginemos la IA como un estudiante muy especial. Este estudiante no tiene un cerebro biológico como nosotros, sino un cerebro digital compuesto de algoritmos y datos. Al igual que un estudiante humano, la IA aprende de la información que se le proporciona, reconoce patrones en los datos y toma decisiones basadas en lo que ha aprendido.

5.2 Breve historia de la IA

La historia de la Inteligencia Artificial es como una montaña rusa de ideas brillantes, grandes esperanzas y desafíos inesperados. Es un viaje que comenzó mucho antes de lo que muchos imaginan y que continúa sorprendiéndonos hoy en día.

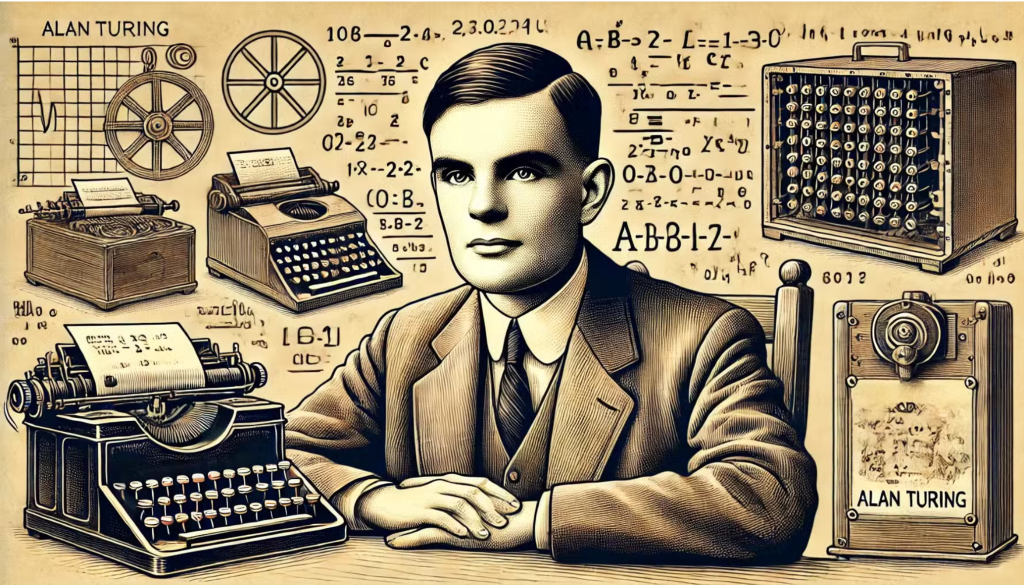

Todo empezó en la década de 1940, cuando la Segunda Guerra Mundial estaba llegando a su fin. En ese momento, un brillante matemático británico llamado Alan Turing comenzó a preguntarse: «¿Pueden las máquinas pensar?» Esta simple pregunta fue la chispa que encendió la llama de la IA.

Pero no fue hasta 1956 cuando la idea realmente despegó. En ese año, un grupo de científicos visionarios se reunió en el Dartmouth College para una conferencia que cambiaría el mundo. Allí, acuñaron el término «Inteligencia Artificial» y soñaron con crear máquinas tan inteligentes como los humanos. Era el comienzo de una era de optimismo desbordante.

Durante las siguientes dos décadas, los investigadores de IA estaban en la cima del mundo. Crearon programas que podían resolver problemas matemáticos complejos e incluso jugar al ajedrez. Parecía que nada podía detenerlos. Sin embargo, como suele suceder con las grandes ambiciones, la realidad pronto les alcanzó.

A mediados de los años 70, la IA se enfrentó a su primer gran desafío. Los investigadores se dieron cuenta de que crear una máquina verdaderamente inteligente era mucho más difícil de lo que habían imaginado. El financiamiento se secó y el entusiasmo se desvaneció. Este período se conoce como el «primer invierno de la IA».

Pero la IA no estaba muerta, solo hibernando. En los años 80, resurgió con una nueva idea: los sistemas expertos. Estos programas podían imitar el proceso de toma de decisiones de un experto humano en campos específicos, como el diagnóstico médico. Por un tiempo, parecía que la IA había encontrado su lugar en el mundo.

Sin embargo, la historia tiene una forma de repetirse. A finales de los 80, la IA se enfrentó a otro período de desilusión. Los sistemas expertos resultaron ser limitados y difíciles de mantener. Una vez más, las expectativas habían superado la realidad y llegó el «segundo invierno de la IA».

Pero como dice el refrán, la tercera es la vencida. Desde mediados de los 90 hasta hoy, la IA ha experimentado un renacimiento espectacular. ¿La razón? Dos ingredientes clave: una potencia de cómputo exponencialmente mayor y cantidades masivas de datos. Estas dos fuerzas han impulsado avances increíbles en áreas como el aprendizaje profundo y el procesamiento del lenguaje natural.

Hoy, la IA está en todas partes: en nuestros teléfonos, en nuestros coches, en nuestros hospitales. Y aunque aún estamos lejos de las máquinas superinteligentes con las que soñaban los pioneros de la IA, cada día nos acercamos un poco más. La historia de la IA nos recuerda que el progreso rara vez es lineal, pero con perseverancia y creatividad, podemos lograr cosas asombrosas.

5.3 Tipos de IA: débil vs. fuerte

Es importante distinguir entre dos conceptos fundamentales en IA:

- IA débil o estrecha: Es la IA que conocemos hoy. Está diseñada para realizar tareas específicas, como jugar al ajedrez, reconocer rostros o conducir un coche. Puede ser extremadamente eficiente en su tarea asignada, pero carece de conciencia o comprensión real.

- IA fuerte o general: Es un concepto teórico de una IA que podría realizar cualquier tarea intelectual que un ser humano pueda hacer. Tendría conciencia y comprensión real de su entorno. Actualmente, esto sigue siendo ciencia ficción.

Para entender mejor esta distinción, pensemos en la IA débil como una calculadora muy avanzada: extremadamente eficiente en cálculos matemáticos, pero incapaz de apreciar la belleza de un poema. La IA fuerte, en cambio, sería más como el cerebro humano, capaz de adaptarse y aprender cualquier tipo de tarea.

6. Ética y tecnología

6.1 Conceptos éticos fundamentales

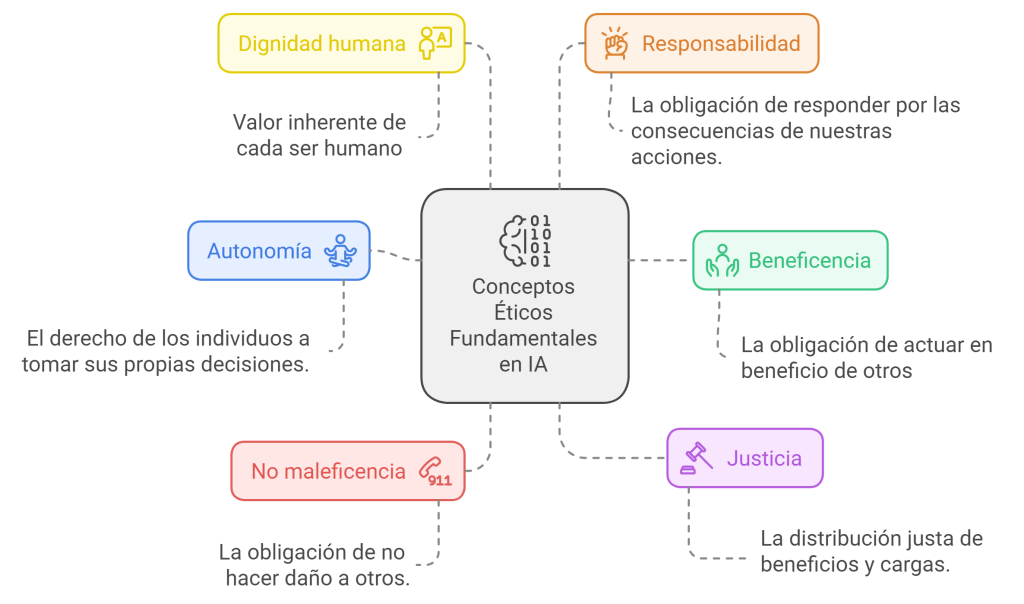

La ética es la rama de la filosofía que se ocupa de la moral, la virtud, el deber, la felicidad y el buen vivir. En el contexto de la tecnología, la ética nos ayuda a navegar las complejas decisiones sobre cómo desarrollar y utilizar las innovaciones de manera responsable.

Algunos conceptos éticos fundamentales que son particularmente relevantes en el contexto de la IA incluyen:

6.2 Cómo la tecnología plantea nuevos dilemas éticos

La tecnología, y especialmente la IA, plantea nuevos dilemas éticos o reformula los existentes de maneras novedosas. Por ejemplo:

- Privacidad: ¿Hasta qué punto es ético que los sistemas de IA recopilen y analicen datos personales?

- Autonomía: ¿Cómo equilibramos la eficiencia de las decisiones tomadas por IA con el derecho de las personas a tomar sus propias decisiones?

- Responsabilidad: Si un coche autónomo causa un accidente, ¿Quién es responsable? ¿El fabricante, el propietario, o la IA misma?

- Equidad y sesgo: ¿Cómo nos aseguramos de que los sistemas de IA no perpetúen o amplifiquen los sesgos existentes en la sociedad?

- Transparencia: ¿Deberíamos tener el derecho de saber cuándo estamos interactuando con una IA y cómo toma sus decisiones?

- Impacto laboral: ¿Cómo manejamos el desplazamiento de trabajos debido a la automatización impulsada por la IA?

- Singularidad tecnológica: Si se desarrollara una IA superinteligente, ¿Cómo nos aseguramos de que sus objetivos estén alineados con los valores humanos?

Estos dilemas no tienen respuestas fáciles, pero es crucial que los abordemos de manera proactiva a medida que la tecnología de IA continúa avanzando y permeando más aspectos de nuestras vidas.

7. Actividad práctica: «Construye tu IA ética»

7.1 Instrucciones de la actividad

En esta actividad, vamos a poner en práctica lo que hemos aprendido sobre IA y ética. Los estudiantes trabajarán en grupos para diseñar una IA ética para un escenario específico.

- Dividid la clase en grupos de 4-5 estudiantes.

- Cada grupo recibirá un escenario diferente donde se podría implementar una IA (por ejemplo, en el sistema de justicia, en la atención médica, en la educación, etc.).

- Los grupos tendrán 20 minutos para diseñar su «IA ética», considerando:

- ¿Qué tarea específica realizará la IA?

- ¿Qué principios éticos debe seguir?

- ¿Qué salvaguardas se implementarán para prevenir problemas éticos?

- Cada grupo presentará su diseño al resto de la clase en una presentación de 3-5 minutos.

7.2 Trabajo en grupos para diseñar principios éticos para una IA

Durante el trabajo en grupo, animad a los estudiantes a considerar preguntas como:

- ¿Cómo se asegurarán de que la IA sea justa y no discriminatoria?

- ¿Cómo manejarán los datos personales y la privacidad?

- ¿Qué nivel de transparencia debería tener el sistema de IA?

- ¿Cómo se manejará la responsabilidad si algo sale mal?

- ¿Cómo se asegurarán de que la IA beneficie a la sociedad en general?

7.3 Presentación y discusión de los diseños

Después de las presentaciones, facilitad una discusión en clase sobre los diferentes diseños:

- ¿Qué similitudes y diferencias hay entre los diseños de los diferentes grupos?

- ¿Qué desafíos éticos fueron los más difíciles de abordar?

- ¿Cómo podrían estos principios éticos aplicarse a las IA que ya existen en el mundo real?

Explorando ChatGPT

8. Introducción a ChatGPT

8.1 ¿Qué es ChatGPT?

ChatGPT es una de las aplicaciones más conocidas y discutidas de la Inteligencia Artificial en la actualidad. Pero, ¿qué es exactamente?

ChatGPT es un modelo de lenguaje avanzado desarrollado por OpenAI. Podemos pensar en él como un super lector que ha «leído» una cantidad masiva de texto de internet y libros, y ha aprendido a predecir qué palabras es probable que sigan a otras.

Imaginad que tenéis un amigo que ha leído prácticamente todos los libros del mundo y tiene una memoria perfecta. ChatGPT es como ese amigo, pero en lugar de un cerebro biológico, tiene un cerebro artificial compuesto de miles de millones de conexiones matemáticas.

8.2 Cómo funciona

El funcionamiento de ChatGPT se basa en un tipo de IA llamada «modelo de lenguaje». Funciona así:

- Entrenamiento: Se alimenta al modelo con enormes cantidades de texto de internet, libros, artículos, etc.

- Aprendizaje de patrones: El modelo aprende patrones en este texto. Por ejemplo, aprende que después de «Hola, ¿cómo» es probable que siga «estás?»

- Generación de texto: Cuando le das un prompt (una entrada de texto), utiliza lo que ha aprendido para predecir qué palabras deberían seguir.

- Contextualización: A medida que genera texto, tiene en cuenta todo lo que ha generado antes para mantener la coherencia.

Es importante entender que ChatGPT no «piensa» en el sentido humano. No tiene comprensión real ni conciencia. Es un predictor de texto muy avanzado, capaz de imitar el lenguaje humano de manera sorprendentemente convincente.

9. Demostración en vivo

9.1 Ejemplos de uso de ChatGPT

Ahora, vamos a ver ChatGPT en acción. Realizaremos una serie de demostraciones para ilustrar sus capacidades y limitaciones:

- Conversación general: Empezaremos con una simple charla para ver cómo responde a preguntas cotidianas. Prompt: «Hola ChatGPT, ¿qué tiempo hace hoy?»

- Resolución de problemas: Veremos cómo maneja una tarea más compleja. Prompt: «Necesito ayuda para planificar una fiesta de cumpleaños para 20 personas con un presupuesto limitado. ¿Puedes darme algunas ideas?»

- Creatividad: Probaremos su capacidad para generar contenido creativo. Prompt: «Escribe un poema corto sobre la amistad entre un robot y un humano.»

- Análisis de texto: Veremos cómo puede analizar y resumir información. Prompt: «Analiza las principales causas y consecuencias de la Revolución Industrial.»

- Traducción: Probaremos su capacidad multilingüe. Prompt: «Traduce la siguiente frase al francés: ‘La inteligencia artificial está cambiando el mundo.'»

9.2 Discusión sobre las capacidades observadas

Después de cada demostración, fomentaremos una discusión en clase:

- ¿Qué os ha sorprendido de las respuestas de ChatGPT?

- ¿En qué aspectos creéis que la respuesta de ChatGPT se parece a la que daría un humano? ¿En qué aspectos es diferente?

- ¿Podéis identificar alguna limitación o error en las respuestas?

Es crucial que los estudiantes entiendan que, aunque impresionante, ChatGPT tiene limitaciones. No tiene acceso a información en tiempo real, puede cometer errores factuales, y a veces puede generar respuestas que parecen convincentes pero son incorrectas o sin sentido.

10. Actividad práctica: «Desafío ChatGPT»

10.1 Instrucciones del desafío

Ahora es el turno de los estudiantes de poner a prueba a ChatGPT. Dividiremos la clase en grupos y cada grupo tendrá la oportunidad de interactuar con ChatGPT.

- Formad grupos de 3-4 estudiantes.

- Cada grupo debe pensar en 3 preguntas o tareas para ChatGPT:

- Una pregunta de conocimiento general

- Una tarea creativa

- Un problema ético o filosófico

- Los grupos tendrán 15 minutos para formular sus preguntas y obtener respuestas de ChatGPT.

- Deben analizar las respuestas y prepararse para presentarlas a la clase.

10.2 Rondas de preguntas creativas a ChatGPT

Animad a los estudiantes a ser creativos con sus preguntas. Algunos ejemplos podrían ser:

- «¿Puedes escribir un diálogo entre Napoleón Bonaparte y un influencer de Instagram?»

- «Explica la teoría de la relatividad como si fueras un pirata del siglo XVIII.»

- «¿Cómo resolverías el dilema del tranvía si fueras un robot programado para no hacer daño?»

10.3 Análisis grupal de las respuestas

Después de que cada grupo haya interactuado con ChatGPT, dedicaremos tiempo a analizar las respuestas:

- ¿Qué os ha sorprendido de las respuestas?

- ¿Habéis notado algún error o inconsistencia?

- ¿Cómo ha manejado ChatGPT las preguntas éticas o filosóficas?

- ¿Creéis que las respuestas son originales o parecen generadas a partir de información existente?

El dilema del tranvía es un experimento filosófico en ética que plantea una difícil decisión moral. La situación es la siguiente:

Imagina que un tranvía fuera de control va por una vía y se dirige hacia cinco personas que están atadas a las vías y no pueden moverse. Tú estás al lado de un desvío que, si accionas, hará que el tranvía cambie de dirección y se dirija por otra vía, donde hay una sola persona atada.

El dilema es: ¿deberías accionar el desvío para cambiar la dirección del tranvía y salvar a las cinco personas, sacrificando a una sola? ¿O deberías no hacer nada y dejar que el tranvía siga su curso, resultando en la muerte de las cinco personas?

Este dilema se utiliza para explorar las decisiones éticas y morales que implican el sacrificio de una vida para salvar a otras, cuestionando si es correcto intervenir y cómo se mide el valor de las acciones.

10.4 Reflexión sobre las fortalezas y limitaciones observadas

Para cerrar esta actividad, guiaremos una reflexión sobre lo que hemos observado:

- Fortalezas: ¿En qué tareas parece destacar ChatGPT? ¿Qué tipo de preguntas responde mejor?

- Limitaciones: ¿Dónde parece fallar o mostrar debilidades? ¿Qué tipos de tareas parecen ser más difíciles para él?

- Implicaciones éticas: ¿Qué preocupaciones éticas surgen al ver estas capacidades? Por ejemplo, ¿cómo podría afectar a la privacidad, la desinformación o el plagio?

- Futuro: Basándoos en lo que habéis visto, ¿cómo creéis que herramientas como ChatGPT podrían cambiar la forma en que aprendemos, trabajamos o nos comunicamos en el futuro?

Dilemas éticos y IA

11. Introducción a los dilemas éticos en IA

11.1 Tipos de dilemas éticos comunes en IA

La Inteligencia Artificial, con todo su potencial, nos presenta una serie de desafíos éticos complejos. Estos dilemas surgen cuando los principios éticos que valoramos entran en conflicto en el contexto de la IA. Algunos de los dilemas más comunes incluyen:

-

- Privacidad vs. Utilidad: Ejemplo: Imagina una aplicación de salud que utiliza IA para predecir posibles enfermedades. Para ser más precisa, la app solicita acceso a tu historial médico completo, hábitos alimenticios, rutina de ejercicios e incluso tu ubicación en tiempo real. ¿Estarías dispuesto a compartir toda esta información personal para obtener predicciones de salud más precisas?

- Autonomía vs. Beneficencia: Ejemplo: Piensa en un coche autónomo programado para priorizar siempre la seguridad. Si detecta que estás conduciendo hacia una zona que considera peligrosa (tal vez debido a condiciones climáticas adversas), ¿debería el coche tomar el control y cambiar la ruta sin tu permiso «por tu propio bien»?

- Transparencia vs. Propiedad Intelectual: Ejemplo: Un banco utiliza un algoritmo de IA para decidir quién recibe préstamos. El algoritmo parece favorecer a ciertos grupos sobre otros, pero el banco se niega a revelar cómo funciona exactamente, alegando que es un secreto comercial. ¿Debería el banco estar obligado a revelar cómo funciona su algoritmo, incluso si eso significa exponer información que podría ser copiada por la competencia?

- Equidad vs. Eficiencia: Ejemplo: Una empresa de contratación utiliza IA para filtrar currículums. El sistema es muy eficiente y ahorra mucho tiempo, pero se descubre que tiende a favorecer a candidatos de ciertas universidades y orígenes, perpetuando así desigualdades existentes. ¿Debería la empresa seguir usando este sistema por su eficiencia, o abandonarlo por cuestiones de equidad?

- Responsabilidad: Ejemplo: Un paciente sufre complicaciones graves porque un sistema de IA de diagnóstico médico no detectó una enfermedad rara. ¿Quién es responsable de este error? ¿El hospital que utilizó el sistema? ¿Los médicos que confiaron en él? ¿La empresa que desarrolló la IA? ¿O el paciente, por aceptar ser diagnosticado por una IA?

11.2 Por qué son importantes estos dilemas

Estos dilemas son cruciales por varias razones:

- Impacto generalizado: La IA está cada vez más presente en nuestras vidas, desde las redes sociales hasta los sistemas de salud.

- Consecuencias a largo plazo: Las decisiones que tomemos ahora sobre la ética en IA pueden tener efectos duraderos en la sociedad.

- Complejidad: Estos dilemas a menudo no tienen respuestas claras y requieren un análisis cuidadoso.

- Ritmo de desarrollo: La tecnología de IA avanza rápidamente, y necesitamos estar preparados para enfrentar nuevos desafíos éticos.

12. Actividad principal: «El tribunal de la IA»

12.1 Preparación: Asignación de roles y casos

Para esta actividad, convertiremos nuestra aula en un «tribunal» donde se juzgarán casos éticos relacionados con la IA. Aquí está cómo lo organizaremos:

- Dividid la clase en grupos de 5-6 estudiantes.

- Cada grupo recibirá un caso ético relacionado con la IA.

- Dentro de cada grupo, asignad los siguientes roles:

- 1-2 abogados defensores (a favor de la implementación de la IA)

- 1-2 fiscales (en contra de la implementación de la IA)

- 1 juez

- 1-2 expertos técnicos en IA

12.2 Presentación de casos éticos

Presentaremos varios casos éticos para que los grupos trabajen. Algunos ejemplos podrían ser:

- Caso de IA en contratación: Una empresa utiliza IA para filtrar candidatos a puestos de trabajo. La IA ha mejorado la eficiencia, pero se ha descubierto que tiende a favorecer a ciertos grupos demográficos.

- Caso de coches autónomos: Un coche autónomo se enfrenta a una situación donde debe elegir entre poner en peligro a sus pasajeros o a un grupo de peatones.

- Caso de IA en el sistema de justicia: Un sistema de IA se utiliza para predecir la probabilidad de reincidencia en criminales, influyendo en las sentencias. Se descubre que el sistema tiene sesgos raciales.

- Caso de IA en salud: Un sistema de IA para diagnóstico médico comete un error grave. Se debate quién es responsable: los médicos, el hospital, o la empresa que desarrolló la IA.

12.3 Consulta a ChatGPT sobre los dilemas

Como parte de la preparación del caso, cada grupo consultará a ChatGPT para obtener perspectivas adicionales sobre su dilema ético. Esto les ayudará a:

- Obtener información adicional sobre el tema.

- Ver cómo una IA analiza cuestiones éticas sobre IA.

- Comparar las respuestas de ChatGPT con sus propios razonamientos.

12.4 Debate y juicio

Cada grupo presentará su caso al resto de la clase:

- El juez introduce el caso.

- Los abogados defensores presentan argumentos a favor de la implementación de la IA.

- Los fiscales presentan argumentos en contra.

- Los expertos técnicos proporcionan contexto y aclaraciones sobre cómo funciona la IA en cuestión.

- Hay un breve período de preguntas y respuestas donde el resto de la clase puede participar.

- El juez delibera y da un veredicto, explicando su razonamiento.

12.5 Reflexión sobre las decisiones tomadas

Después de que todos los casos hayan sido presentados, guiaremos una reflexión en clase:

- ¿Qué casos fueron los más difíciles de juzgar y por qué?

- ¿Cómo influyeron las consultas a ChatGPT en vuestros argumentos?

- ¿Notasteis algún patrón en cómo se abordaron los diferentes dilemas éticos?

- ¿Cómo podrían estos dilemas afectar a vuestra vida cotidiana en el futuro?

13. Análisis comparativo

13.1 Respuestas de ChatGPT vs. razonamiento humano

Para cerrar esta sección, haremos un análisis comparativo entre las respuestas que dio ChatGPT a los dilemas éticos y el razonamiento que siguieron los estudiantes:

- ¿En qué se parecieron las respuestas de ChatGPT a las vuestras?

- ¿En qué se diferenciaron?

- ¿Detectasteis algún sesgo o limitación en las respuestas de ChatGPT?

- ¿Creéis que ChatGPT «entiende» realmente las implicaciones éticas de estos dilemas?

13.2 Discusión sobre las diferencias y similitudes

Finalizaremos con una discusión sobre las implicaciones más amplias de lo que hemos observado:

- ¿Qué ventajas y desventajas veis en utilizar IA para analizar dilemas éticos?

- ¿Creéis que la IA podría ayudarnos a tomar decisiones éticas más justas en el futuro? ¿Por qué sí o por qué no?

- ¿Cómo podríamos asegurarnos de que los sistemas de IA se desarrollen de manera ética?

- ¿Qué papel creéis que deberían jugar los humanos en la toma de decisiones éticas en un mundo cada vez más automatizado?

Reflexión y conclusiones

14. Debate final: «El futuro de la IA en la sociedad»

14.1 Formación de grupos pro y contra

Para este debate final, dividiremos la clase en dos grandes grupos:

- Grupo Pro-IA: Argumentará a favor de una adopción amplia y rápida de la IA en la sociedad.

- Grupo Precaución-IA: Abogará por un enfoque más cauteloso y regulado en la implementación de la IA.

Dentro de cada grupo, los estudiantes pueden formar subgrupos para abordar diferentes aspectos del debate (por ejemplo, IA en educación, salud, trabajo, etc.).

14.2 Preparación de argumentos

Cada grupo tendrá 20 minutos para preparar sus argumentos. Deben considerar:

- Los beneficios potenciales o riesgos de la IA en diferentes sectores de la sociedad.

- Ejemplos concretos para respaldar sus argumentos.

- Posibles contraargumentos del otro grupo y cómo responderían.

Animad a los estudiantes a utilizar todo lo que han aprendido durante el taller, incluyendo los conceptos éticos, los ejemplos de ChatGPT, y los dilemas éticos discutidos.

14.3 Debate estructurado

El debate seguirá esta estructura:

- Introducción (2 minutos por grupo)

- Argumentos principales (5 minutos por grupo)

- Refutación (3 minutos por grupo)

- Preguntas cruzadas (5 minutos de preguntas entre grupos)

- Conclusiones (2 minutos por grupo)

14.4 Votación y discusión de resultados

Tras el debate, realizaremos una votación anónima en clase:

- ¿Qué grupo presentó argumentos más convincentes?

- ¿Ha cambiado vuestra opinión sobre la IA después del debate?

- En una escala del 1 al 10, ¿cuán optimistas os sentís sobre el futuro de la IA en la sociedad?

Discutiremos los resultados de la votación, explorando por qué la clase se inclinó en una dirección u otra.

15. Desarrollo de un marco ético personal

15.1 Actividad individual de reflexión

Ahora que hemos explorado en profundidad los aspectos éticos de la IA, es momento de que cada estudiante desarrolle su propio marco ético personal para el uso de la IA. Proporcionad a los estudiantes 15 minutos para reflexionar y escribir sobre las siguientes preguntas:

- ¿Cuáles son tus tres principales preocupaciones éticas sobre el uso de la IA?

- ¿Qué tres beneficios potenciales de la IA te entusiasman más?

- ¿Qué límites personales establecerías en tu uso de la IA (por ejemplo, en educación, redes sociales, toma de decisiones)?

- ¿Cómo equilibrarías la innovación tecnológica con la responsabilidad ética?

15.2 Creación de pautas éticas personales para el uso de IA

Basándose en su reflexión, pedid a los estudiantes que creen un conjunto de 5-7 pautas éticas personales para el uso de la IA. Estas pautas deben ser específicas, accionables y reflejar sus valores personales. Por ejemplo:

- «Me comprometo a verificar siempre la información generada por IA con fuentes confiables.»

- «Utilizaré herramientas de IA para mejorar mi productividad, pero no para reemplazar el pensamiento crítico o la creatividad.»

15.3 Compartir y discutir en pequeños grupos

Dividid la clase en grupos pequeños (3-4 estudiantes) para compartir y discutir sus pautas éticas personales:

- ¿Qué similitudes y diferencias observáis en vuestras pautas?

- ¿Cómo reflejan estas pautas lo que habéis aprendido durante el taller?

- ¿Creéis que estas pautas cambiarán con el tiempo? ¿Por qué?

16. Conclusiones y cierre

16.1 Resumen de los aprendizajes clave

Repasemos juntos los puntos clave que hemos cubierto en este taller:

- La IA es una tecnología poderosa con un gran potencial, pero también conlleva desafíos éticos significativos.

- Es crucial distinguir entre los mitos y las realidades de la IA para tomar decisiones informadas.

- Herramientas como ChatGPT tienen capacidades impresionantes, pero también limitaciones importantes.

- Los dilemas éticos en IA son complejos y a menudo no tienen respuestas sencillas.

- Desarrollar un marco ético personal es esencial para navegar el futuro de la IA de manera responsable.

16.2 Reflexión final sobre la importancia de la ética en la era de la IA

Para cerrar, reflexionemos sobre por qué todo esto es importante:

- La IA está transformando rápidamente nuestra sociedad, y vosotros, como futuros líderes, profesionales y ciudadanos, tendréis un papel crucial en dar forma a cómo se desarrolla y utiliza esta tecnología.

- Comprender los aspectos éticos de la IA os permitirá tomar decisiones más informadas y responsables, tanto en vuestra vida personal como profesional.

- La ética en la IA no es solo una cuestión tecnológica, sino una cuestión profundamente humana que toca aspectos fundamentales de nuestra sociedad, como la justicia, la privacidad y la autonomía.

José Luis de la Torre Lorente

Profesor de historia y Director de

Profesor de historia y Director de